[John and Mary]

Can a machine express or even judge itself in terms of emotions or pain? And what do we as human viewers understand about it, or how do we understand it?

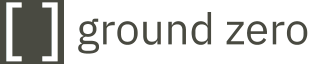

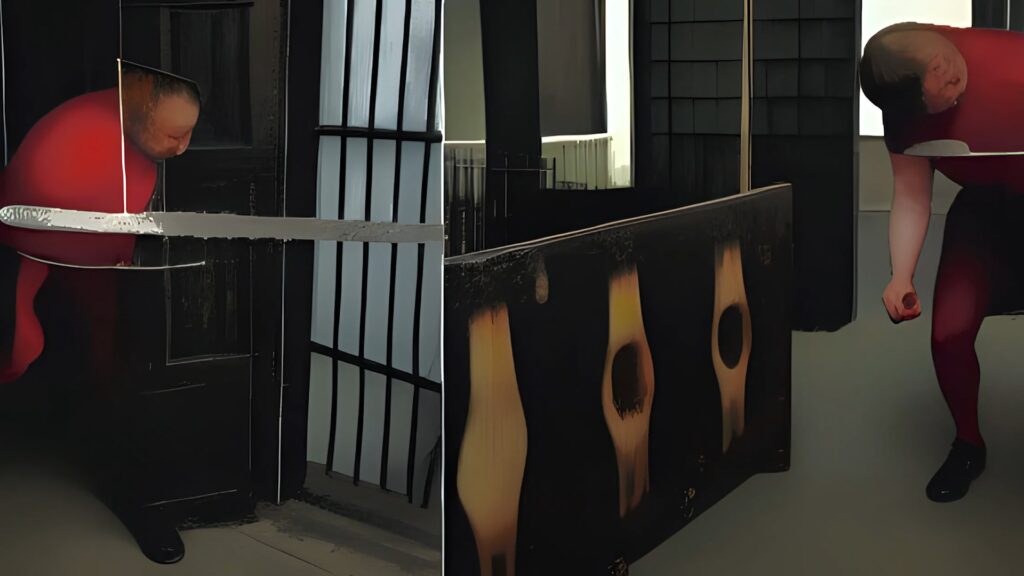

The video work [John and Mary] is an audiovisual experiment and a differential experience that blurs the boundaries between human and machine, natural and artificial algorithms, emotion and its machine reproduction. A tension between machine and human semantics is formed, blurring and ambiguities in language open up new spaces of meaning.

Lisa Reutelsterz

“Is it ethical to build systems that can be afraid, sad, or happy?

Are we even allowed to use these machines as mere instruments for our purposes?” Catrin Misselhorn

The fact that emotions are one of the fundamental sources of our moral actions and coexistence makes us think about the extent to which and whether artificial systems or machines can – and should – also simulate, understand, or even exhibit them.

Can a machine express or even judge itself in terms of emotions or pain? And what do we as human viewers in turn understand about it, or how do we understand it? The video work [John and Mary] is an audiovisual experiment and experience of difference that blurs the boundaries between human and machine, natural and artificial algorithms, emotion and its machine reproduction.

The work marks the beginning of a series of projects that explore the possibilities and risks of affective computing in a multimedia and artistic way. Affective Computing is an interdisciplinary field of research that, among other things, develops artificial intelligences not only to recognize states of human emotions, but also to be able to react to them appropriately.

Based on the above questions, texts in the form of poems, scenario essays, etc. were generated using a language model with artificial neural embeddings (GPT-3). In a subsequent step, these generated texts were then read line by line into various image diffusion models (Stable Diffusion, Dall-E 2, stability ai) to convert them into synthetic images and videos.

In affective computing, machine learning techniques are used to evoke aesthetic experiences at the interfaces of human-generated and computer-generated texts and images in order to make cognitive systems empathetic. Similarly, in [John and Mary], the synthetic moving images were decontextualized and presented to different participants.

Within this process, they functioned as human algorithms, so to speak, who wrote texts in the form of poems, prose, essays, etc.. They were to write their own individual interpretation of the machine-generated videos. The authors themselves are also the ones who can be heard in the VoiceOver of the video work.

Thus, within dreamlike sequences, a seemingly sacral maelstrom emerges that seduces the viewer to grasp meaning in the machine-generated images. A tension between machine and human semantics emerges. Abstractions, blurriness, and ambiguities in language open up new spaces of meaning. The question arises as to what is the original and how human beings and machines can be distinguished from each other, as well as the social power of effect.

Direction/Concept/Editing: Lisa Reutelsterz

Poems/Voices: Jan Reutelsterz, Björn Gabriel, Stephan Weigelin, Anna Marienfeld, Benita Martis, Nina Berner

Sound: Jan & Lisa Reutelsterz

Videoarbeit, 17’46”

“Ist es ethisch vertretbar, Systeme zu bauen, die Furcht haben, traurig sein oder sich freuen können?

Dürfen wir diese Maschinen überhaupt noch als reine Instrumente für unsere Zwecke benutzen?” Catrin Misselhorn

Die Tatsache, dass Emotionen eine der fundamentalen Quellen unseres moralischen Handelns und Zusammenlebens sind, lässt uns darüber nachdenken, inwiefern und ob auch künstliche Systeme oder Maschinen diese simulieren, verstehen oder sogar aufweisen können – und sollten.

Kann sich eine Maschine im Hinblick auf Emotionen oder Schmerzempfinden ausdrücken oder gar beurteilen? Und was verstehen wir wiederum als menschliche Betrachter*innen davon, bzw. wie verstehen wir sie? Die Videoarbeit [John and Mary] versteht sich als audiovisuelles Experiment und Differenzerfahrung, welche die Grenzen zwischen Mensch und Maschine, natürlichen und künstlichen Algorithmen, Emotion und deren maschinelle Reproduktion, verwischt.

Die Arbeit stellt den Beginn einer Projektreihe dar, die multimedial und künstlerisch die Möglichkeiten und Risiken von Affective Computing auslotet. Einem interdisziplinären Forschungsfeld, das u.a. Künstliche Intelligenzen entwickelt, um Zustände menschlicher Emotionen nicht nur zu erkennen, sondern auch auf diese angemessen reagieren zu können.

Ausgehend von den o.g. Fragen wurden für [John and Mary] Texte in Form von Gedichten, Szenarien Essays etc. mittels eines Sprachmodells mit künstlich neuronalen Einbettungen (GPT-3) generiert. In einem Folgeschritt wurden diese generierten Texte dann zeilenweise in diverse Bilddiffusionsmodelle (Stable Diffusion, Dall-E 2, stability ai) eingelesen um sie in synthetische Bilder und Videos umzuwandeln.

Beim Affective Computing wird mithilfe maschineller Lerntechniken versucht an den Schnittstellen von mensch- und computergenerierten Texten und Bildern ästhetische Erfahrungen hervorzurufen, um kognitive Systeme empatisch werden zu lassen. So wurden auch bei [John and Mary] die synthetischen Bewegtbilder dekontextualisiert und verschiedenen Probanden vorgelegt.

Sie fungierten innerhalb dieses Prozesses quasi als menschliche Algorithmen, die auf Anweisung Texte in Form von Gedichten, Prosa, Essays u.s.w. verfassten. Sie sollten ihre eigene, individuelle Interpretation der maschinengenerierten Videos schreiben. Die Autor*innen selbst sind es auch, die jeweils im VoiceOver der Videoarbeit zu hören sind.

So entsteht innerhalb traumartiger Sequenzen ein sakral anmutender Sog, der dazu verführt in den maschinengenerierten Bildern Bedeutung zu fassen. Es bildet sich ein Spannungsverhältnis von maschineller und menschlicher Semantik heraus. Abstraktionen, Unschärfen und Mehrdeutigkeiten in der Sprache öffnen neue Bedeutungsräume. Es stellt sich die Frage nach dem Ursprünglichen und nach der Unterscheidbarkeit von Mensch und Maschine sowie der gesellschaftlichen Wirkmacht.

Regie/Konzept/Montage: Lisa Reutelsterz

Gedichte/Gesprochen von: Jan Reutelsterz, Björn Gabriel, Stephan Weigelin, Anna Marienfeld, Benita Martis, Nina Berner

Sound: Jan & Lisa Reutelsterz

video work, 17’46”